近日,DataPipeline宣布完成A+轮数千万元人民币融资,经纬创投继续加码。本轮融资由BV百度风投领投,清流资本跟投。

自2017年12月投资DataPipeline A轮后,经纬创投持续加码至今。经纬创投合伙人熊飞表示,“我们非常看好数据时代下,一流产品创业公司的商业机会。DataPipeline有着一流技术背景,以及一流的客户口碑,获得了星巴克、金风科技等相当多零售、能源等行业的标杆客户,客户数和收入都在高速健康成长,我们非常看好公司的前景。”

DataPipeline创始人陈诚表示,“本轮融资将用于加速提升数据融合平台的硬实力,持续优化提升行业客户服务的软实力,进一步加强产品、研发和营销团队,完善客户拓展和客户成功体系。”

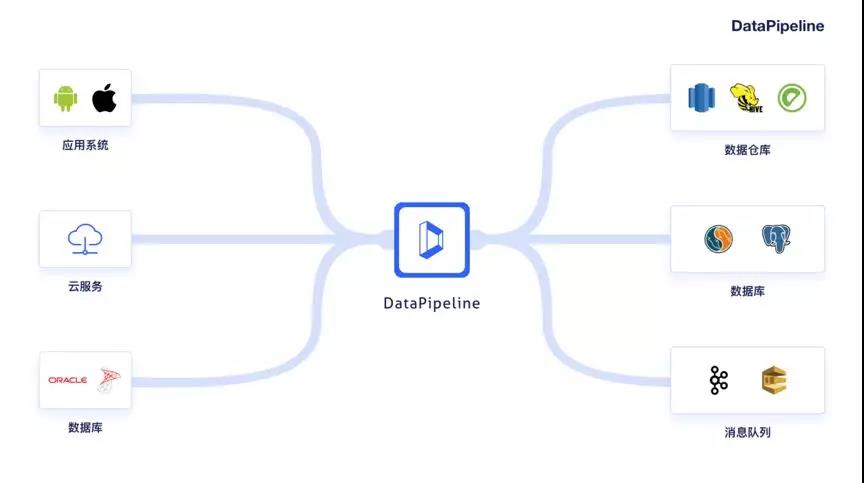

DataPipeline成立于2016年3月,专注为客户提供一站式数据与应用集成平台和方案。其核心团队分别来自谷歌、Yelp、亚马逊、IBM、甲骨文、中科院等国内外知名企业,借助数十年大数据开发和项目经验,帮助客户更敏捷、高效地实现复杂异构数据源到目的地实时数据融合和数据管理,从而支撑客户通过数据分析更精准地驱动商业决策和业务决策。

目前,DataPipeline已经成功服务了星巴克、金风科技、龙湖地产、财通证券、叮当快药等大型企业客户,且行业涉及零售、制造、金融、能源、互联网等。同时,DataPipeline已与数十家产业上下游合作伙伴建立了战略合作关系。

随着大数据时代的到来,企业不仅仅在数据存储量上发生了变化,同时对于数据及时性要求也越来越高。传统的数据集成模式渐渐不能满足企业快速决策以及各种实时查询、实时计算的需求,传统数据集成工具的时效性瓶颈越发明显。

区别于传统数据集成方案,DataPipeline从创立之初就在产品架构、方案设计及操作体验等方面进行了充分的调研和创新,产品和方案都更契合当前中国企业客户的需求。

一、数据量庞大

企业逐年暴涨的大数据量对传统集成系统提出了严峻挑战,传统ETL工具的高并发性能测试往往不达标或扩展性不足,先天不支持分布式架构,无法提供实时和批处理选择。

DataPipeline采用分布式的底层框架体系,产品可扩展性方面比较灵活,可以根据资源的性能消耗情况,灵活地增量水平节点,超出传统ETL工具几个量级的高并发数和可扩展性。同时可以支持客户每天平稳并行传输数千张表、数百GB增量数据,累计传输数据超过数十TB。

二、数据实时性

实时的数据供应链是数据驱动企业的命脉,随着企业异构数据源和目的地种类的日益增多,采用传统ETL工具或自己编写脚本复杂度和维护成本都非常高。

DataPipeline可以支持多种异构数据源和目的地的自动化数据交换,目前已经支持20多个主流数据源和目的地。通过解析数据库的复制日志去捕获数据与数据定义的变化,让数据同步任务能够做到实时自适应。

三、数据质量管理

采用传统集成方案,往往在完成数据同步后,企业客户却无法及时地管控数据质量,缺少数据质量预警及相应的补救措施。

DataPipeline数据质量平台整合了数据质量分析、质量校验、质量监控等多方面特性,以保证数据质量的完整性、一致性、准确性及唯一性。

四、高效敏捷易用

当前,传统集成方案在ETL中固化的转换不是优势反而成为一种束缚,难以满足当前企业在业务和数据应用方面瞬息万变的需求。

DataPipeline通过提供批流一体的数据集成、数据质量管理、API数据接入、元数据管理、任务调度以及可视化运维与监控等服务,在减少数据集成、融合开发和运维成本的同时,提高了开发及运维的效率。目前,DataPipeline采用可视化配置界面,无需任何代码5分钟即可创建数据同步任务。

五、部署及收费模式

在部署模式上,DataPipeline支持混合云、跨云、私有化等多种模式。为了让私有化部署成本更低、效率更高,DataPipeline采用当前先进的容器技术。为了提升非私有环境的安全性,DataPipeline对混合云、跨云的部署模式进行加密。在收费模式上,DataPipeline按照客户系统所占用的服务器收取年费。

DataPipeline创始人陈诚表示,“如果我们把数据想象成商品,DataPipeline想通过构建一个智能化无人商店,让客户可以按照自身需求自由选择所需商品。在这个行业里有一句话叫‘Garbage in, garbage out’,如果传递的数据是垃圾,那么产生的数据价值也是垃圾。DataPipeline一直致力于保障数据质量、来源都是可供、可追溯的。 ”